空洞卷积(Dilated Convolution)简介

一、空洞卷积(Dilated Convolution)Dilated Convolution(空洞卷积/膨胀卷积)是在标准的 convolution map 里注入空洞,以此来扩大感受野。膨胀卷积与普通的卷积相比:除了卷积核的大小以外,还有一个扩张率(dilation rate)参数,主要用来表示膨胀的大小。在普通卷积中,可以认为它的dilated rate = 1。感受野(receptive f

一、空洞卷积(Dilated Convolution)

Dilated Convolution(空洞卷积/膨胀卷积)是在标准的 convolution map 里注入空洞,以此来扩大感受野。膨胀卷积与普通的卷积相比:除了卷积核的大小以外,还有一个扩张率(dilation rate)参数,主要用来表示膨胀的大小。在普通卷积中,可以认为它的dilated rate = 1。

感受野(receptive field):CNN中,某一层输出结果中一个元素所对应的输入层的区域大小,感受野是卷积核在图像上看到的大小,例如3×3卷积核的感受野大小为9。越大的感受野包含越多的上下文关系。

适用情况:在图像需要全局信息、语音文本需要较长的sequence信息依赖的问题。

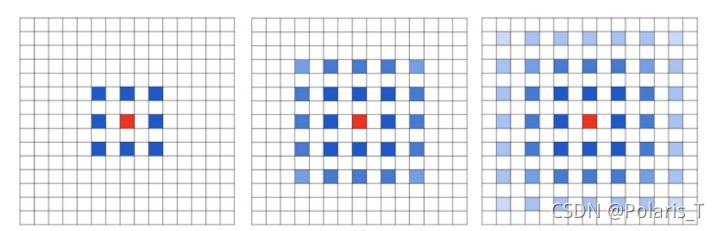

膨胀卷积:保持参数个数不变的情况下增大了卷积核的感受野,让每个卷积输出都包含较大范围的信息。与此同时,它可以保证输出的特征映射(feature map)的大小保持不变。对比传统的conv操作,3层3x3的卷积加起来,stride为1的话,只能达到(kernel-1)*layer+1=7的感受野,也就是和层数layer成线性关系,而膨胀卷积的感受野是指数级的增长。

1.Standard Convolution with a 3 x 3 kernel (and padding):

2.Dilated Convolution with a 3 x 3 kernel and dilation rate 2:

二、空洞卷积存在的问题

1:The Gridding Effect

假设仅多次叠加 dilation rate 2 的 3 x 3 kernel 的话,则会出现这个问题:kernel 并不连续,也就是并不是所有的 pixel 都用来计算了,因此这里将信息看做 checker-board 的方式会损失信息的连续性。这对 pixel-level dense prediction 的任务来说是致命的。

2:Long-ranged information might be not relevant.

我们从 dilated convolution 的设计背景来看就能推测出这样的设计是用来获取 long-ranged information。然而光采用大 dilation rate 的信息或许只对一些大物体分割有效果,而对小物体来说可能则有弊无利了。如何同时处理不同大小的物体的关系,则是设计好 dilated convolution 网络的关键。

解决:通向标准化设计Hybrid Dilated Convolution (HDC)

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)